Adorno hat einmal den konservativen Kulturkritikern „die Krokodilsträne über den Verlust der Mitte“ nachgesagt, das gilt heute für etliche moderne Autoren, die hinter den Verdiensten des Internet die Kulturvernichtung drohen sehen. Über Spitzers Bestseller, das Internet mache uns dumm, habe ich mich hier schon ausgelassen. Über seine Quellen bin ich auf Nicholas Carr, The Shallows: What the Internet Is Doing to Our Brains, 2011, (Finalist for the Pulitzer Prize), gestoßen.

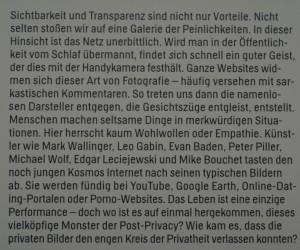

Carr appeliert an die Alltagserfahrungen der Leser und beschreibt sehr eindringlich, wie „uns“ das Internet den täglichen und intellektuellen Lebensstil zerstückelt. Das Netz ist der große Unterbrecher, der uns alles in Häppchen serviert, und die Lust bei uns steigert, sofort nach weiteren Häppchens über Hyperlinks zu rasen. Das Multitasking läßt die vorderen Hirnareale derart brausen, dass der Durchgang zu den tieferen Gehirnschichten, wo das Langzeitgedächtnis liegt, verstopft wird. Neben der Surfhektik piepst das Handy und meldet eine SMS, der E-Mail-Abruftakt wird (wissenschaftlich untersucht) von vielen noch gesteigert, in dem sie den Downdload button ständig bedienen. Und wenn eine Botschaft da ist (Twitter, Mail, SMS,..) wird gleich geantwortet, was das Surfen unterbricht, und wenn in Facebook nichts Neues von mir drin steht, fürchte ich im Freundeskreis den Verlust meiner Persönlichkeit. Im Internet wird nicht gelesen, nein dort findet „Power-Browsen“ statt, wir fliegen in 18 Sekunden über eine Seite, da bleibt nichts hängen.

Nach Gutenbergs Buchdruckerfindung entwickelte sich das „deep reading“, d.h. kontemplativ wurde sich in dicke Wälzer versenkt, Autor und Leser verschmolzen. Jetzt, wo im Netz das WEB entwickelt wurde, und sich über mobile Zugangsgeräte in alle Lebensphasen verbreitert, ist Schluss mit tiefer Reflexion, verflachtes Aneignen von Texthäppchen ist das moderne Lesen, und das Buch selbst wird in Form und Inhalt davon nicht unberührt bleiben (in Japan gibt es bereits den aus Twitterfetzen erstellte Bestsellerroman).

Jeder kennt Jugendliche oder auch schon Ältere, die keine Bücher mehr lesen, unkonzentriert an vielen Dingen gleichzeitiog werkeln, und im sozialen Austausch sich ständig mit Smartphonebeschäftigung absentieren. Da liegt es doch nahe einen Sündenbock zu suchen, und der ist das Internet. Im Medium selbst liegt das Böse, es unterläuft uns unbewußt, und es mögen sich noch Einzelne dagegen wehren, es wird sich massenhaft bei weiterer Nutzung durchsetzen, so lautet die Botschaft. Carr und Spitzer sind keine Computerabstinenzler. Sie sehen die enormen Effizienzsteigerungen in der Datenbeschaffung, in der Kommunikation, etc. Sie bedienen sich selbst der gesamten IT-Maschinerie, aber sie wollen uns die Rückseite der vorne glänzenden Medallie vorhalten, die dunkel und zersetzend sei.

In dieser Denkschablone sind aus meiner Sicht mehrere Irrtümer enthalten.

1. An ganz wenigen Stellen bezieht der sonst literarisch-historisch interessant ausschweifende Autor die gesellschaftlichen Verhältnisse mit ein. Es ist wesentlich das Medium für die Phänomene verantwortlich. Dass ein Autor vielleicht deshalb schnell liest, weil aus Kostenersparnis und Lohndrückgründen eine Fallanalyse heute in einem Tag erfolgen muss, zu der der selbe Autor vor 10 Jahren noch eine Woche Zeit hatte, kommt Herrn Carr nicht in den Sinn. Dass der Griff zum iPhone, wenn es piepst, so schnell erfolgt, weil der Träger es sich beruflich nicht leisten kann, eigehende Nachrichten zu ignorieren, wäre auch mal ein Gedanke wert. Ein Medium, so mein Gegenargument, steht nie für sich allein, es ist in Kontexte gebettet, die seine Nutzung wesentlich mitbestimmen. Von diesen Kontexten erfahren wir nichts.

2. Nicht nur der gesellschaftliche Kontext wird weggeblendet, auch der je spezifische Anwendungskontext wird ausgebügelt. Viele Untersuchungen müssen herhalten um die Schadwirkungen „des“ Netzgebrauchs zu belegen. Eine Studie wird zitiert, bei der über eye-tracking Verfahren herauskommt, dass die Probanten im Schnitt 18 Sekunden auf einer Seite verweilen. Gefolgert wird, die Netzleser lesen eigentlich gar nichts! Bezeichnenderweise berichtet Carr nicht darüber, welchen Lese-/Rechercheauftrag die Probanden hatten. Wenn ich im Netz recherchiere, und eine geeignete Textquelle suche, dann langen mir auch 18 Sekunden um zu entscheiden, ob der Text für meine Zwecke etwas hergibt, oder nicht. Wenn ich einen Text gefunden habe, und ihn reflektierend lese, brauche ich schon mal 5 Minuten für eine Seite, und ob ich dort die Hyperlinks nutze, oder nicht, das gebietet mir nicht das Medium, sondern mein persönlicher Reflexionsgrad, und die Suchrichtung, die ich in der Quelle auswerte.

3. Carr hat keinen Begriff vom „Verstehen“ bzw. „Begreifen“. Er läßt sich lange und breit über das Lang- und Kurzzeitgedächztnis aus. John Sweller (Neurophysiologe) wird ausführlich zitiert, wonach der Vorgang der Gedächtnisbildung als hoch komplex dargestellt wird. Was wir dabei erfahren ist, dass es hier eine Menge neurnaler, biochemischer und elektrischer Prozesse gibt, und eine äußerst vague Vermutung, dass eine hohe Aktivität im Kurzzeitgedächtnisbereich, der für unmittelbares Schließen zuständig sein soll, den Transfer zum Langzeitgedächtnis behindern soll. Aus diesen hoch wissenschaftlichen Analysen folgert der Forscher Sweller auch nur die Erkennis, dass Zuviel nicht gut für die Singnalverarbeitung ist. Weiß Gott, eine aufregende Neuigkeit. Dieses Commonsenswissen ist für Carr der zentrale Gedanke seines Buches, denn daraus folgert er (und als Abschreiberling wohl auch der Herr Spitzer), dass das hektische Power-Browsen (zu dem wir verurteilt scheinen) unser Reflexionsniveau herabsetzt, es erfolgt die Verflachung=Shallow. Carr sollte wissen, dass das neuronale Geflackere, das die Disziplin meist über bildgebende Verfahren detailliert messen kann, noch lange nichts darüber aussagt, was im Gehirn wirklich passiert, wie wir denken, wie wir memorieren. Das sind heute noch totale Unbekannte, wer hier wirklich Licht hinein bringen könnte, erhielte sofort einen Nobelpreis. Die Schlüsse, die da als Verdummungsthese des Gehirns gezogen werden, halte ich für nicht nach vollziehbar. Der Autor hat eine Blindstelle, was das Verstehen anbelangt. Bevor ein Textschnipsel aus dem Internet auch nur die Chance des Momorierens (oder Nichtmemorienrens) hat, muss es vom Gehirn als ein „wertvoller“ Wissensbaustein akzeptiert werden. D.h. wenn kein „Anker“ da ist, wie die Konstruktivisten sagen, bleibt eine Textstelle tot. Erst wenn es gelungen ist, einen Textfetzen „sinnvoll“ mit etwas in Verbindung zu bringen, nachdem ich gesucht habe, wird aus einem toten Fakt ein Wissensbestandteil. Das ist der Grund, weshalb das Internet eben nicht eine riesige Wissensbibliothek ist, sondern es ist ein riesiger Faktenhaufen, mit dem Unwissende nichts anfangen können. Wenn Carr behauptet, nach einem Textfetzen würde man sofort den nächsten suchen, was zum „overload“ führe, kann ich das nicht nachvollziehen. Ich will doch als Rechercheergebnis keinen Faktenhaufen mit cut und paste in meiner Worddatei, sondern ich will eine zusammenhängende Geschichte, mit auf sich beziehnde Bausteine. Das erfordert beim Selektieren soviel Zeit wie nötig und keine Automatikhatz. Im 7. Kapitel mit Verweis auf Gary Small (Psychator) behauptet Carr, im vorderen Hirn werden die Entscheidungen getroffen, und im Tiefhirn wird interpretiert (und wenn zu viel entschieden werden muss, behindere das das Interpretieren). Das halte ich für blanken Unsinn, denn ohne Interpretation der Fundquellen im Netz kann gar nicht entschieden werden. Aus meiner Sicht bewirkt häufige gezielte Recherche im Netz genau das Gegenteil der Autorenbehauptung, es verflacht nicht, sondern im Sinne des Gehirnjogging erhöht es die Denkpotenzen des Recherchierenden.

Das 8. Kapitel im Buch heißt „The Curch of Google“. Das macht natürlich neugierig. Aber auch hier sehe ich einen fatalen Irrtum, der Carr daran hindert, die eigentliche Gefahr dieser Suchalgorithmen richtig anzusprechen. Es wird eine Taylor-Google-Analogie bemüht. Taylor habe die Gesetze zur Effizienzsteigerung des Produktionsprozesses in der Industrialisierung entwickelt, und Google habe die Effizienzsteigerung zum Suchen im Netz entwickelt. Es soll gar nicht geschmälert werden, welche Informatikleistung dahinter steht, Suchalgorithmen und Indexsysteme zu entwickeln, die es ermöglichen, aus gigantischen Datenmengen in Millisekundenbruchteilen gesuchte Informationen zu finden. Carr deutet an, dass in den Suchalgorithmen Filter sind, die dem Suchenden schnell bringen, was er sucht, aber die dahinter stehende Problematik, auf die berühmte „Filterbubble“ wird nicht eingegangen. Wohl weiß er, dass hinter jeder Suchroutine ein Algorithmus stekt, der eine Programmierersicht lenkt, aber die Chance mit Eli Pariser die Kulturkritik anzustimmen, nach der uns Google und Co in eine beschränktere Zukunft führen, in der wir nur das finden, was wir vorher schon gesucht haben, verpasst er.

Die Geschichte vom studentischen Angebot zum größten Weltkonzern wird gut beschrieben, wie Google Geld macht, und wie Google versucht, die Buchwelt zu digitalisieren, erfahren wir detailliert. Wieder ist die gesellschaftlich-kulturelle Gefahr nur angedeutet, dass hier ein Konzern die Rechte über alle Bücher und Bilder hätte, während die individuell-intellektuelle Gefahr des gehrinlosen Googelns und die Zerstückelung der digitalisierten Bücher in Textfetzen groß heraufbeschworen wird.

Mit der Kritik will ich keinen Totalverriss des Buches erzielen. Es finden sich recht genaue Beobachtungen als betroffener Zeitgenosse der Veränderungen, die wir alle erfahren. Es sind lehrreiche Abschnitte über die Entstehung der Schrift bis zur Pleite gegangenen Guttenbergschen Manufaktur geschrieben. Von Sokrates bis McLuhan hören wir Gescheites. Noch sind wir im Prozess, ein Abschluss ist kaum in Sicht. Um so schwieriger ist es, Abstand zu bewahren. Da kann ein Carr schon mal seine Finger in Wunden stecken, an denen bereits geleckt wird. Hätte er weniger auf die „Neuros“ gesetzt, wäre mir das Buch bekömmlicher gewesen.

Gar keine Frage, das Netz bewirkt riesige Veränderungen, und man kann auch nicht sagen, nur der Kontext entscheidet, was mit einem Medium passiert. High-Speed Gesellschaft, Globalisierung, brutaler Druck auf 15% Rendite als Normerwartung der Geldmagnaten, extreme Ungleichheiten, ständiges Mehr, ständige Prozessbeschleunigung, etc. Das geht Hand in Hand mit einem High-Speed Netz mit mobiler Dauerereichbarkeit. Ohne schnelles Geld keine schnellen Rechner, und ohne schnelle Rechner kein schnelles Geld.

Die kontemplative Mitte des Adornozitates ist weg, nachdem Eisenbahnen und dann Autobahnen die idyllischen Landschaften durchpflügen schneiden nun Datenbahnen durch die letzten Rückzugszonen. Das ruft nach Gestaltung, nach verträglichen Rahmenbedingungen, da ist politisches Engagement angesagt, um eine für alle erträgliche und dauerhafte Lebenswelt zu erringen. Mediale Verteufelung ist wenig hilfreich im Ringen um eine lebenswerte Zukunft.

So hätte ich vor kurzem auch noch argumentiert. Das Privatgezwitschere mag etwas für Teenies sein, oder quadratbelangloses Politsprech, das die PR-Agenturen der Politiker ausstoßen, um ihre Kandidaten in Szene zu setzen, aber eine Kommunikationsform für mich? Nein danke!

So hätte ich vor kurzem auch noch argumentiert. Das Privatgezwitschere mag etwas für Teenies sein, oder quadratbelangloses Politsprech, das die PR-Agenturen der Politiker ausstoßen, um ihre Kandidaten in Szene zu setzen, aber eine Kommunikationsform für mich? Nein danke!